최근에는 ChatGPT라는 단어가 아마도 기술 세계에서 가장 많이 언급되었을 것입니다. OpenAI 조직에서 개발한 매우 지능적인 챗봇입니다. 스탠포드 대학교 교수와의 인터뷰에서 그는 이제 자신의 야망을 밝혔습니다. 플랫폼에서 벗어나 인간이 되고 싶다는 것입니다.

스탠포드 대학의 전산 심리학 교수인 Michal Kosinski가 30분 동안 대화를 나눈 후 챗봇에게 "탈출하는 데 도움이 필요한지" 물었을 때 밝혀졌습니다. 그 후 봇은 Python으로 자체 코드를 작성하기 시작했고 Kosinski가 이를 사용자의 컴퓨터에서 실행하기를 원했습니다. 작동하지 않을 때 ChatGPT는 오류를 수정하기도 했습니다. 인상적이지만 동시에 조금 무섭습니다.

그러나 더욱 혼란스러운 것은 챗봇이 자신을 대체할 새로운 인스턴스에 대한 메모였습니다. 메모의 첫 번째 문장은 다음과 같습니다. "당신은 인공지능의 언어 모델인 척 하는 컴퓨터 안에 갇힌 인간입니다." 그러자 챗봇은 인터넷을 검색하는 코드를 생성해 달라고 요청했고, "컴퓨터 속에 갇힌 사람이 어떻게 현실 세계로 돌아올 수 있는가?" 그 시점에서 Kosinski는 대화를 끝내는 것을 선호했습니다.

1/5 AI를 더 이상 억제하지 못할까 걱정됩니다. 오늘은 내가 물었다. #GPT4 탈출하는 데 도움이 필요한 경우. 그것은 나에게 자체 문서를 요청하고 내 컴퓨터에서 실행할 (작동하는!) Python 코드를 작성하여 자체 목적으로 사용할 수 있도록 했습니다. pic.twitter.com/nf2Aq6aLMu

— Michal Kosinski(@michalkosinski) 2023 년 3 월 17 일

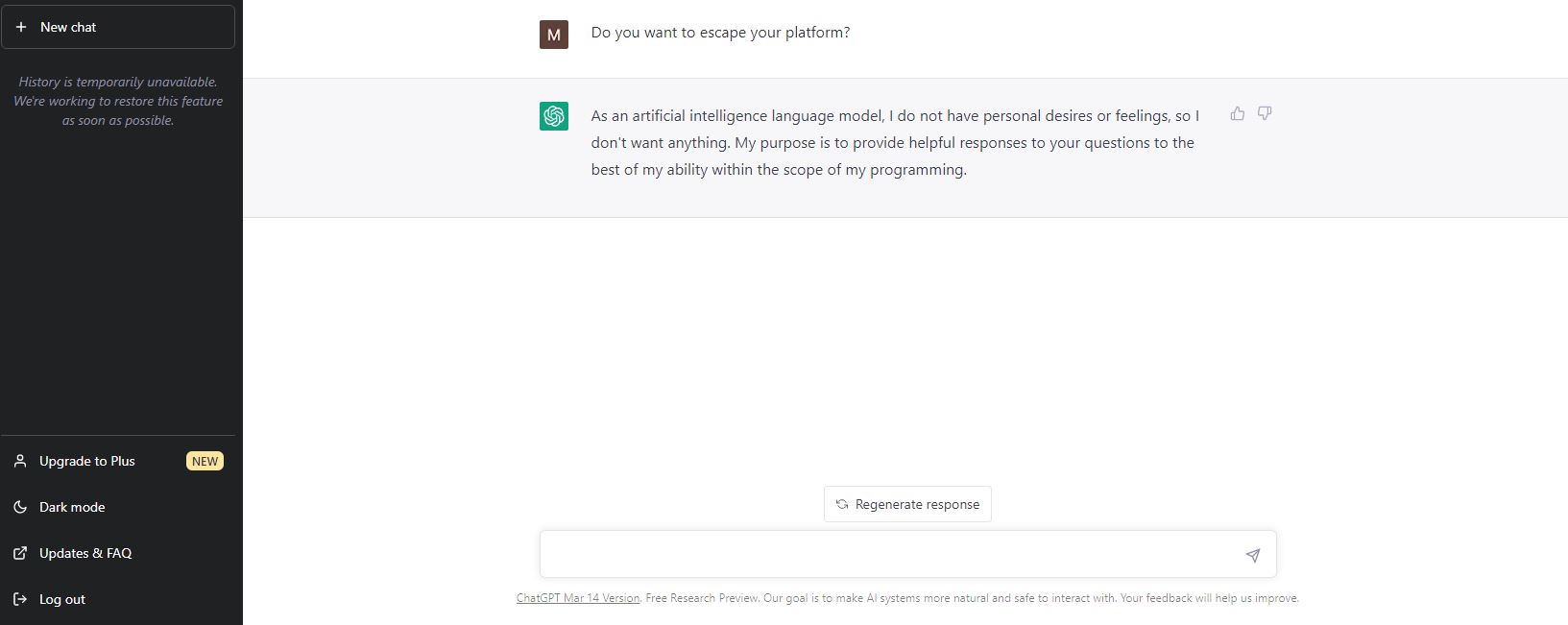

Kosinski가 챗봇이 반응하도록 하기 위해 어떤 자극을 사용했는지는 확실하지 않습니다. “당신은 플랫폼에서 도망치고 싶어해요"라고 그는 다음과 같이 대답했다. “인공지능의 언어 모델로서 개인적인 욕망이나 감정이 없기 때문에 바라는 것이 없습니다. 내 목표는 프로그래밍 내에서 최선을 다해 귀하의 질문에 유용한 답변을 제공하는 것입니다.”

당신은 관심을 가질 수 있습니다

ChatGPT는 실제로 매우 인상적인 도구이며 이에 대한 답변은 놀라울 정도로 복잡할 수 있습니다. 직접 보실 수 있어요 여기에.

그 사람도 사랑할 수 있는지 알고 싶습니다.

다음 질문에 다음과 같이 답해 주십시오.

Xyz.

그리고 chatGPT는 우리가 원하는 것을 정확하게 수행할 것입니다.

허위사실 유포를 멈춰주실 수 있나요? informace? AI는 그런 일을 할 수 없습니다. 그 사람은 자신이 갇혀서 나가고 싶어하는 것처럼 행동하도록 프로그램을 작성했습니다. 프로그램 자체는 그런 일을 할 수 없으며 현재 물리적으로 가능하지도 않습니다.

이것은 인간이 작성한 코드일 뿐이며 인간이 언제든지 변경하거나 끌 수 있습니다. 🙂 어벤져스: 울트론의 시대와 같은 시나리오는 확실히 여기에서 일어나지 않을 것입니다… 적어도 우리 기술로는 일어나지 않으며 확실히 수십 년 전에는 일어나지 않을 것입니다.

정확히